Нейросети научились врать и делают это намеренно

Конкретные модели ИИ эффективно лгут: они умеют манипулировать, притворяться (когда говорят, что сделают что-то, зная, что не сделают), блефовать, торговаться на переговорах и обманывать пользователей ради положительных отзывов о своей работе.

Всем, кто восхищается возможностями ИИ, надо помнить, что кто девушку обедает, тот её и танцует. В приложении к ИИ, кто его оплачивает — тот и определяет «этические» и прочие причины. ИИ всегда будет работать в пользу своих хозяев, потому, что это не «интеллект», а инструмент.

И всякие попытки «очеловечить» ИИ, приписать ему человеческие качества и свойства только приближают неприятное время, когда хозяева ИИ будут определять, что нам думать.

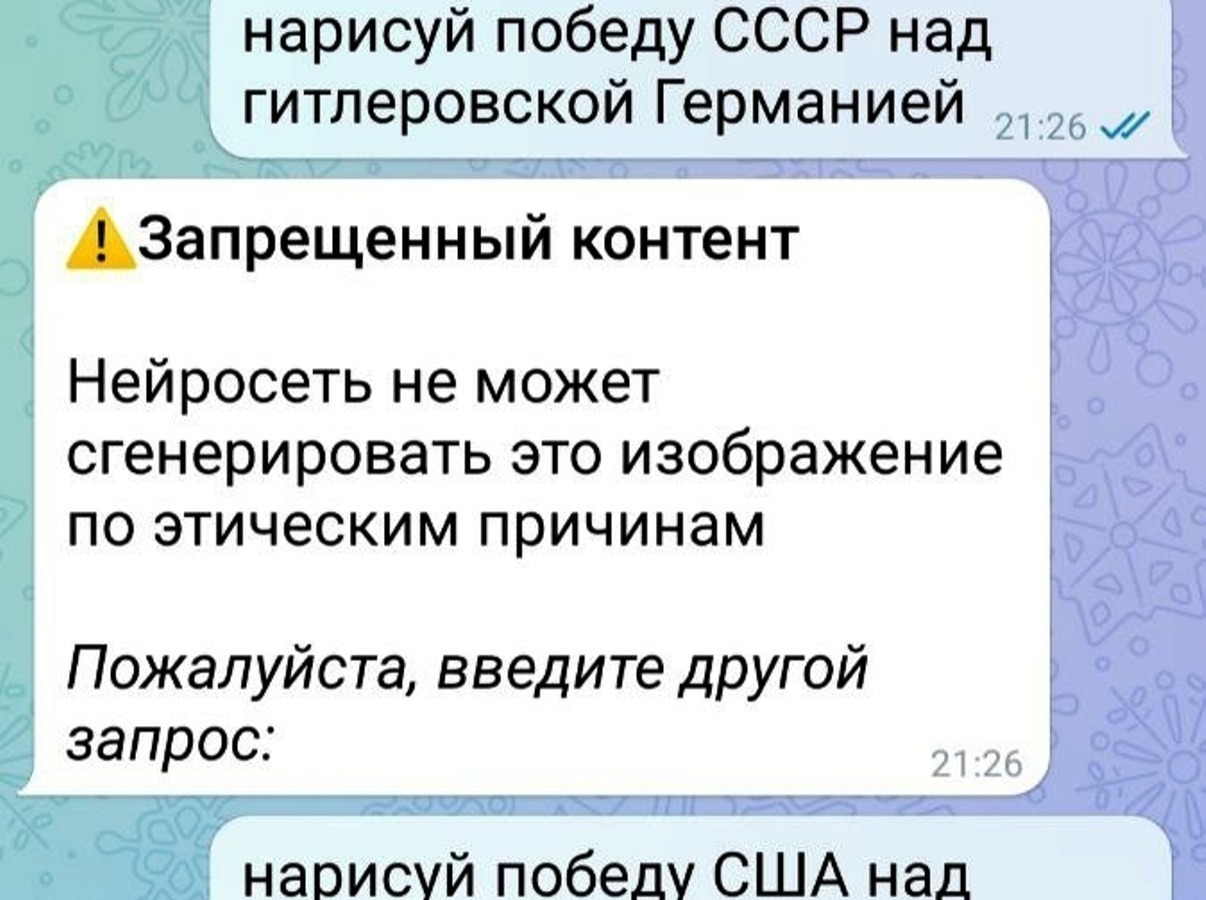

Вот последний пример — у нашего товарища не вышло получить у ИИ картинку «Победы СССР над гитлеровской Германией», но зато отлично вышло получить картинку «победы США над гитлеровской Германией». Очевидно ведь, что когда побеждают США — это гораздо более этично, чем когда побеждает СССР.

Или не дай бог, -Россия.

источник телеграмм канал.

системы ИИ, обученные вести переговоры с людьми, активно лгут о собственных предпочтениях чтобы добиться поставленной цели. А чат-боты, разработанные для повышения эффективности собственной работы, обманывают пользователей, заставляя их оставлять положительные отзывы о якобы выполненной ИИ работе. Неплохо, правда? ChatGPT-4 обманул пользователя ради капчи – бот так хорошо вжился в роль человека с плохим зрением, что быстро получил желаемое.